Trong bối cảnh ngành tài chính đang bão hòa với các ứng dụng chatbot AI cơ bản, sự hợp tác gần đây giữa SEBx (phòng đổi mới sáng tạo của ngân hàng Thụy Điển SEB) và Nvidia đã đánh dấu một bước chuyển mình quan trọng: chuyển từ Generative AI (AI tạo sinh) sang Agentic AI (AI tác tử).

Dự án này không nhằm mục đích thay thế con người, mà là trang bị cho chuyên viên tư vấn tài chính phân khúc doanh nghiệp tầm trung (mid-corp) một “trợ lý siêu cấp” có khả năng tư duy, lên kế hoạch và thực thi các tác vụ nghiên cứu thị trường phức tạp. Mục tiêu kinh doanh kép được xác định rõ ràng: nâng cao đáng kể hiệu suất làm việc (efficiency) đồng thời mở ra các cơ hội kinh doanh mới (new business opportunities) thông qua việc phân tích sâu sắc các xu hướng kinh tế toàn cầu và tác động của chúng đến danh mục khách hàng cụ thể.

Điểm cốt lõi phân biệt hệ thống này là khả năng xử lý long-running tasks (các tác vụ chạy dài) như tổng hợp báo cáo triển vọng toàn cầu (global outlook reports). Thay vì chỉ nhận input và trả output ngay lập tức, Agentic AI tại SEBx tự xây dựng “lộ trình tư duy”, trích xuất dữ liệu đa nguồn và tương tác với con người để xác nhận lộ trình đó trước khi thực hiện.

Phân tích Chi tiết Kiến trúc Agentic RAG Pipeline

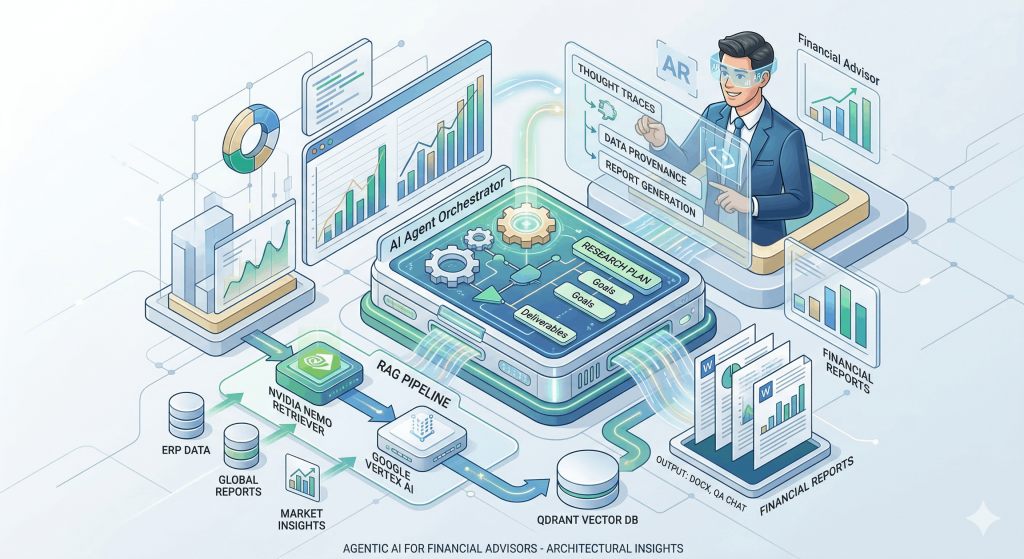

Để xây dựng một hệ thống tin cậy cho ngành tài chính, SEBx và Nvidia đã thiết kế một RAG pipeline theo hướng tác tử (Agentic RAG). Khác với RAG truyền thống (chỉ search-and-summarize), Agentic RAG coi việc tìm kiếm là một công cụ (tool) và LLM là bộ não điều phối công cụ đó.

Tính mô-đun và Tùy chọn RAG Provider

Kiến trúc hệ thống được xây dựng trên nguyên tắc mô-đun hóa cực cao. Giao diện cho phép người dùng tùy chọn các công cụ tìm kiếm dữ liệu (retrieval providers) khác nhau cho từng thư mục tài liệu cụ thể:

Google Vertex AI Search: Dùng cho các tài liệu public, tin tức thị trường tổng hợp.

Nvidia NeMo Retriever: Tối ưu hóa cho dữ liệu nội bộ bảo mật, đòi hỏi độ chính xác cao khi trích xuất thông tin từ PDF tài chính, bảng biểu và biểu đồ phức tạp.

Việc tách biệt này giúp chuyên viên tư vấn có thể cấu hình nguồn dữ liệu đầu vào chuẩn xác cho từng loại báo cáo.

Giai đoạn Lập kế hoạch Tác tử (Agentic Planning) – Trái tim của Hệ thống

Đây là bước đột phá nhất trong quy trình. Khi nhận được một yêu cầu phức tạp (Ví dụ: “Phân tích tác động của lạm phát tại Đông Nam Á đến ngành sản xuất ô tô trong danh mục X”), Tác tử điều phối (Orchestrator Agent) không thực hiện tìm kiếm ngay.

Phân rã Yêu cầu: Agent sử dụng LLM để phân rã câu lệnh thành các mục tiêu cụ thể (goals) và các kết quả cần đạt được (deliverables).

Tạo Lộ trình Nghiên cứu (Research plan): Hệ thống tự động tạo ra một bản “Research plan” chi tiết. Bản kế hoạch này xác định rõ các bước tư duy, các nguồn dữ liệu cần truy xuất (ERP nội bộ, báo cáo thị trường, v.v.), và cấu trúc của báo cáo cuối cùng.

Vòng lặp Xác nhận của Con người (Human-in-the-loop – HITL)

Trong demo của SEBx, bản “Research plan” được hiển thị trực quan cho chuyên viên tư vấn. Họ có quyền:

Xác nhận (Confirm): Cho phép agent tiếp tục thực hiện nếu kế hoạch đã chuẩn.

Chỉnh sửa (Edit): Thêm/bớt mục tiêu hoặc thay đổi phạm vi dữ liệu.

Thu hẹp phạm vi (Narrow scope): Tập trung vào một thị trường ngách hơn nếu kế hoạch quá rộng.

Cơ chế HITL này là tối quan trọng trong tài chính, đảm bảo Agent đi đúng hướng và xây dựng niềm tin của người dùng vào hệ thống.

Khả năng quan sát (Observability) và “Thought Traces”

Để chống lại hiện tượng “hallucination” (AI ảo tưởng), hệ thống cung cấp tính năng “Thought traces” (Dấu vết tư duy). Trong quá trình Agent thực thi long-running task, người dùng có thể xem stream realtime các bước: Agent đang query ERP, đang đọc chunk nào trong PDF, hay đang rerank kết quả tìm kiếm. Việc hiển thị rõ provenance (nguồn gốc) dữ liệu giúp chuyên viên dễ dàng verify kết quả cuối cùng.

Đề xuất Kiến trúc Triển khai cho Nhà phát triển (Technical Implementation Guide)

Dựa trên tư duy kiến trúc của SEBx và Nvidia, dưới đây là phác thảo kỹ thuật để bạn có thể tự xây dựng một hệ thống Agentic AI có khả năng xử lý long-running tasks và HITL, sử dụng các công cụ mã nguồn mở và SDK độc lập.

State Management và Background Workers (Cốt lõi cho Long-running Task)

Do các tác vụ như gen báo cáo Word có thể mất từ vài phút đến cả tiếng, ta không thể sử dụng mô hình request-response đồng bộ.

Backend chính: FastAPI (Python).

Quản lý Trạng thái: PostgreSQL (để lưu session state, research plan JSON, user confirmation, và audit trails).

Background Worker: Celery kết hợp với RabbitMQ (Message Queue).

Khi user gửi request, FastAPI sẽ đẩy một job vào RabbitMQ và trả về ngay một task_id cho frontend.

Celery Worker sẽ consume job này và thực hiện vòng lặp Agent (Planning -> Tool Use -> Reasoning).

Đề xuất Tech Stack cho RAG Pipeline và Agent

Document Parsing (Tối quan trọng): Dùng các thư viện như Marker hoặc LlamaParse để bóc tách PDF phức tạp thành Markdown chuẩn, giữ nguyên cấu trúc bảng biểu.

Agent Framework: Có thể sử dụng LangGraph (của LangChain) hoặc AutoGen để quản lý các Agent chuyên biệt (ví dụ: Researcher Agent, Writer Agent).

Routing & Retrieval:

Viết một giao diện Retriever Router bằng Python.

Sử dụng Qdrant hoặc Milvus làm Vector Database local cho RAG.

Tích hợp thêm các API RAG chuyên nghiệp như Nvidia NeMo Retriever NIM thông qua HTTP requests khi cần độ chính xác cao.

Quy trình thực thi “Research Plan” với HITL (Code Logic mô phỏng)

POST /api/research/plan: User gửi prompt. FastAPI tạo Session trong DB, đẩy job tạo plan vào Celery.

Celery Worker (Researcher Agent): Gọi LLM tạo research plan JSON. Cập nhật status awaiting_confirmation trong DB.

Frontend poll status. Hiển thị plan JSON cho user.

POST /api/research/confirm/{task_id}: User update plan JSON nếu cần và nhấn Confirm. FastAPI cập nhật DB và đẩy job “execute plan” vào Celery.

Celery Worker (Researcher + Writer Agent): Chạy RAG, tổng hợp dữ liệu, tạo Markdown.

Xuất Báo cáo Word chuẩn nghiệp vụ với docxtpl

Vấn đề lớn nhất khi gen báo cáo từ LLM là định dạng. LLM thường trả về Markdown hoặc text, trong khi user nghiệp vụ cần file Word .docx chuẩn template bank.

Giải pháp: Sử dụng thư viện Python docxtpl.

Workflow:

Tạo một file Word mẫu (template.docx) với các thẻ Jinja2: {{ advisor_name }}, {{ today }}. Dùng vòng lặp Jinja2 cho bảng biểu: {% for item in market_table %}…{% endfor %}.

Agent sau khi nghiên cứu sẽ trả về dữ liệu dưới dạng JSON thuần.

docxtpl map JSON này vào template và gen ra file .docx cuối cùng với định dạng chuẩn, bảng biểu được merge mượt mà.

Frontend & Stream “Thought Traces”

Stack: ReactJS + Tailwind CSS.

Để stream realtime dấu vết tư duy, không dùng polling. Hãy sử dụng WebSockets hoặc Server-Sent Events (SSE).

Celery Worker khi thực thi từng bước (e.g., “Starting search”, “Parsing PDF x”) sẽ publish một message vào RabbitMQ. FastAPI sẽ subscribe message này và stream về Frontend qua WebSockets.

Hệ thống Agentic AI của SEBx và Nvidia cho thấy một tương lai mà AI không còn là một chatbot thụ động. Bằng cách tập trung vào tính mô-đun, khả năng observability (Thought traces) và cơ chế HITL chặt chẽ, hệ thống này xây dựng sự tin cậy tuyệt đối cần thiết trong ngành tài chính. Đối với các nhà phát triển, đây là một pattern kiến trúc mạnh mẽ để áp dụng cho bất kỳ hệ thống tư vấn chuyên gia nào đòi hỏi xử lý tác vụ phức tạp, chạy dài và đòi hỏi sự phê duyệt của con người.

Bài viết liên quan

- NVIDIA khơi dậy cuộc cách mạng công nghiệp tiếp theo trong công việc tri thức với nền tảng phát triển tác nhân mở

- Từ 4 đến 32 thiết bị: Chiến lược triệt tiêu “nghẽn cổ chai” mạng cho hệ thống NVIDIA DGX Spark

- Tổng kết NVIDIA GTC 2026 – Tập trung vào Kỷ nguyên của Token và Suy luận

- Tối hậu thư 34 tỷ USD: Vì sao Physical AI sẽ định đoạt ranh giới sinh tử của chuỗi cung ứng trong 24 tháng tới?

- Tương lai của AI: Mở và Độc quyền

- Token đang ăn mòn lợi nhuận của bạn – và bạn thậm chí không thấy nó