CPU NVIDIA Vera mang lại hiệu năng và tiết kiệm năng lượng cao nhất cho việc xử lý dữ liệu, huấn luyện AI và suy luận dựa trên tác nhân ở quy mô lớn.

Tóm tắt tin tức:

- CPU NVIDIA Vera mang lại hiệu suất gấp đôi và tốc độ nhanh hơn 50% so với các CPU truyền thống.

- Các khách hàng hợp tác với NVIDIA để triển khai Vera CPU bao gồm Alibaba, ByteDance, Meta và Oracle Cloud Infrastructure, cùng với CoreWeave, Lambda, Nebius và Nscale.

- Các đối tác sản xuất hiện đang sử dụng CPU Vera bao gồm Dell Technologies, HPE, Lenovo và Supermicro, cùng với ASUS, Compal, Foxconn, GIGABYTE, Pegatron, Quanta Cloud Technology (QCT), Wistron và Wiwynn.

GTC — Hôm nay, NVIDIA đã ra mắt CPU NVIDIA Vera, bộ xử lý đầu tiên trên thế giới được thiết kế chuyên dụng cho kỷ nguyên trí tuệ nhân tạo tác nhân và học tăng cường — mang lại hiệu quả gấp đôi và tốc độ nhanh hơn 50% so với các CPU truyền thống có kích thước tiêu chuẩn.

Khi trí tuệ nhân tạo (AI) về khả năng suy luận và hoạt động như một tác nhân phát triển, quy mô, hiệu suất và chi phí ngày càng phụ thuộc vào cơ sở hạ tầng hỗ trợ các mô hình lập kế hoạch nhiệm vụ, chạy công cụ, tương tác với dữ liệu, chạy mã và xác thực kết quả.

CPU NVIDIA Vera được xây dựng dựa trên thành công của CPU NVIDIA Grace™ , cho phép các tổ chức thuộc mọi quy mô và ngành nghề xây dựng các nhà máy AI để khai phá trí tuệ nhân tạo (AI) ở quy mô lớn. Với hiệu năng đơn luồng và băng thông trên mỗi lõi cao nhất, Vera là một thế hệ CPU mới mang lại thông lượng, khả năng phản hồi và hiệu quả AI cao hơn cho các dịch vụ AI quy mô lớn như trợ lý lập trình, cũng như các tác nhân dành cho người tiêu dùng và doanh nghiệp.

Các nhà cung cấp dịch vụ điện toán đám mây quy mô lớn hàng đầu hợp tác với NVIDIA để triển khai Vera bao gồm Alibaba, CoreWeave, Meta và Oracle Cloud Infrastructure, cũng như các nhà sản xuất hệ thống toàn cầu như Dell Technologies , HPE, Lenovo, Supermicro và nhiều công ty khác. Việc áp dụng rộng rãi này đã đưa Vera trở thành tiêu chuẩn CPU mới cho các tác vụ AI quan trọng nhất đối với các nhà phát triển, công ty khởi nghiệp, các tổ chức công tư và doanh nghiệp — giúp dân chủ hóa việc tiếp cận AI và thúc đẩy đổi mới.

“Vera đang tiến đến một bước ngoặt đối với trí tuệ nhân tạo. Khi trí tuệ trở nên độc lập – có khả năng suy luận và hành động – tầm quan trọng của các hệ thống điều phối công việc đó được nâng cao,” Jensen Huang, người sáng lập và CEO của NVIDIA, cho biết. “CPU không còn chỉ đơn thuần hỗ trợ mô hình; nó đang điều khiển mô hình. Với hiệu năng và hiệu quả năng lượng đột phá, Vera mở khóa các hệ thống AI có khả năng tư duy nhanh hơn và mở rộng quy mô hơn nữa.”

Có thể cấu hình cho mọi trung tâm dữ liệu.NVIDIA đã công bố một giá đỡ CPU Vera mới tích hợp 256 CPU Vera làm mát bằng chất lỏng để hỗ trợ hơn 22.500 môi trường CPU đồng thời, mỗi môi trường hoạt động độc lập với hiệu suất tối đa. Các nhà máy AI có thể nhanh chóng triển khai và mở rộng quy mô lên hàng chục nghìn phiên bản và công cụ tác nhân đồng thời trong một giá đỡ duy nhất.Giá đỡ Vera mới được xây dựng bằng kiến trúc tham chiếu mô-đun NVIDIA MGX™ , được hỗ trợ bởi 80 đối tác hệ sinh thái trên toàn thế giới.

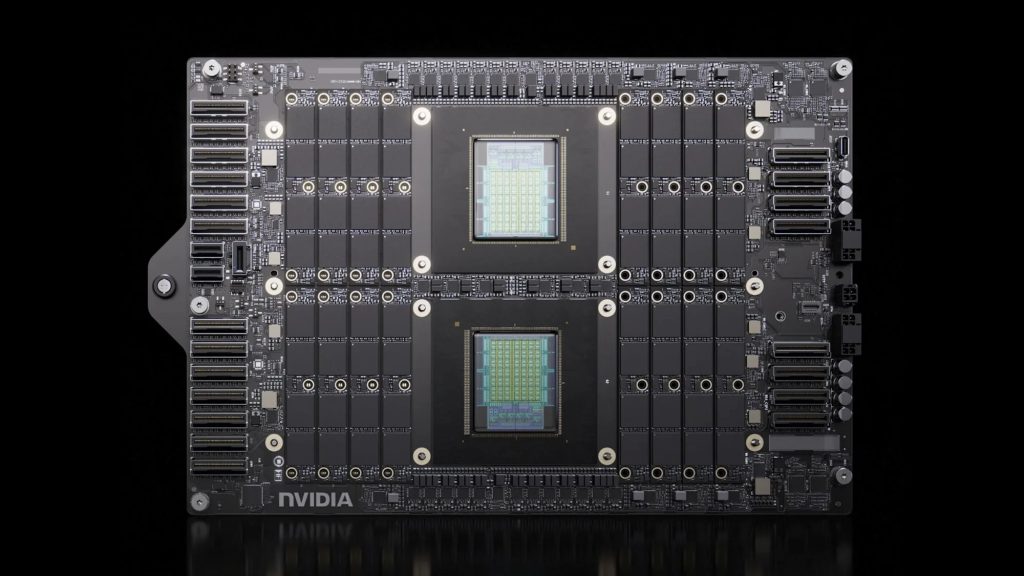

Là một phần của nền tảng NVIDIA Vera Rubin NVL72 , CPU Vera được ghép nối với GPU NVIDIA thông qua công nghệ kết nối NVIDIA NVLink™-C2C, với băng thông đồng bộ 1,8 TB/s — gấp 7 lần băng thông của PCIe Gen 6 — để chia sẻ dữ liệu tốc độ cao giữa CPU và GPU. Ngoài ra, NVIDIA đã giới thiệu các thiết kế tham chiếu mới sử dụng Vera làm CPU chủ cho hệ thống NVIDIA HGX™ Rubin NVL8, điều phối việc di chuyển dữ liệu và điều khiển hệ thống cho các tác vụ được tăng tốc bằng GPU.

Các đối tác của Vera Systems cung cấp cả cấu hình máy chủ CPU đơn và kép, tối ưu cho các khối lượng công việc như học tăng cường, suy luận tác nhân, xử lý dữ liệu, điều phối, quản lý lưu trữ, ứng dụng đám mây và điện toán hiệu năng cao.

Trên tất cả các cấu hình, hệ thống Vera tích hợp card NVIDIA ConnectX® SuperNIC và bộ xử lý NVIDIA BlueField® – 4 DPU để tăng tốc mạng, lưu trữ và bảo mật, những yếu tố quan trọng đối với trí tuệ nhân tạo dựa trên tác nhân. Điều này cho phép khách hàng tối ưu hóa cho khối lượng công việc cụ thể của họ trong khi vẫn duy trì một ngăn xếp phần mềm duy nhất trên toàn bộ nền tảng NVIDIA.

Được thiết kế cho khả năng mở rộng của tác nhân:Bằng cách kết hợp các lõi CPU hiệu năng cao, tiết kiệm năng lượng, hệ thống con bộ nhớ băng thông cao và kiến trúc NVIDIA Scalable Coherency Fabric thế hệ thứ hai, Vera cho phép phản hồi nhanh hơn của tác nhân trong điều kiện sử dụng khắc nghiệt thường gặp đối với trí tuệ nhân tạo tác nhân và học tăng cường.

Vera sở hữu 88 lõi Olympus do NVIDIA thiết kế riêng, mang lại hiệu năng cao cho trình biên dịch, công cụ thời gian chạy, quy trình phân tích, công cụ tác nhân và dịch vụ điều phối. Mỗi lõi có thể chạy hai tác vụ, sử dụng công nghệ đa luồng không gian NVIDIA, để mang lại hiệu năng ổn định và dễ dự đoán — lý tưởng cho các nhà máy AI đa người dùng chạy nhiều tác vụ cùng một lúc.

Để nâng cao hơn nữa hiệu quả năng lượng, Vera giới thiệu thế hệ thứ hai của hệ thống bộ nhớ tiết kiệm năng lượng của NVIDIA, nay được xây dựng trên bộ nhớ LPDDR5X và cung cấp băng thông lên đến 1,2 TB/s — gấp đôi băng thông và chỉ bằng một nửa công suất so với CPU đa năng.

Cursor, một nhà tiên phong trong lĩnh vực phát triển phần mềm dựa trên trí tuệ nhân tạo, đang áp dụng NVIDIA Vera để tăng hiệu suất cho các tác nhân lập trình AI của mình.

“Chúng tôi rất hào hứng sử dụng CPU NVIDIA Vera để cải thiện hiệu suất và năng suất tổng thể, từ đó mang đến trải nghiệm lập trình nhanh hơn và phản hồi tốt hơn cho khách hàng,” Michael Truell, đồng sáng lập kiêm CEO của Cursor cho biết.

Redpanda, một nền tảng hàng đầu về dữ liệu truyền phát và trí tuệ nhân tạo, đang sử dụng Vera để tăng hiệu suất một cách đáng kể.

“Gần đây, Redpanda đã thử nghiệm NVIDIA Vera với các tác vụ tương thích với Apache Kafka và nhận thấy hiệu suất vượt trội hơn hẳn so với các hệ thống khác mà chúng tôi đã đánh giá, mang lại độ trễ thấp hơn tới 5,5 lần,” Alex Gallego, người sáng lập và CEO của Redpanda cho biết. “Vera đại diện cho một hướng đi mới trong kiến trúc CPU, với nhiều bộ nhớ hơn và ít chi phí phụ hơn trên mỗi lõi, cho phép khách hàng của chúng tôi mở rộng quy mô các tác vụ truyền phát trực tuyến thời gian thực hơn bao giờ hết và mở khóa các ứng dụng AI và tác nhân mới.”

Các phòng thí nghiệm quốc gia có kế hoạch triển khai CPU Vera bao gồm Trung tâm Siêu máy tính Leibniz, Phòng thí nghiệm Quốc gia Los Alamos, Trung tâm Tính toán Khoa học Nghiên cứu Năng lượng Quốc gia thuộc Phòng thí nghiệm Quốc gia Lawrence Berkeley và Trung tâm Tính toán Cao cấp Texas (TACC).

“Tại TACC, chúng tôi gần đây đã thử nghiệm nền tảng CPU Vera của NVIDIA khi chuẩn bị triển khai trong hệ thống Horizon sắp tới của mình — và khi chạy sáu ứng dụng khoa học, chúng tôi đã thấy những kết quả ban đầu ấn tượng,” ông John Cazes, giám đốc điện toán hiệu năng cao tại TACC, cho biết. “Hiệu năng trên mỗi lõi và băng thông bộ nhớ của Vera thể hiện một bước tiến khổng lồ cho điện toán khoa học, và chúng tôi mong muốn mang các nút dựa trên Vera đến với người dùng CPU của chúng tôi trên Horizon vào cuối năm nay.”

Các nhà cung cấp dịch vụ đám mây hàng đầu đang lên kế hoạch triển khai CPU Vera bao gồm Alibaba, ByteDance, Cloudflare, CoreWeave, Crusoe, Lambda, Nebius, Nscale, Oracle Cloud Infrastructure, Together.AI và Vultr.

Các nhà cung cấp cơ sở hạ tầng hàng đầu sử dụng CPU Vera bao gồm Aivres , ASRock Rack, ASUS, Compal, Cisco, Dell, Foxconn, GIGABYTE, HPE, Hyve, Inventec, Lenovo, MiTAC, MSI, Pegatron, Quanta Cloud Technology (QCT), Supermicro, Wistron và Wiwynn.

Sản phẩmNVIDIA Vera hiện đang được sản xuất hàng loạt và sẽ có mặt trên thị trường thông qua các đối tác vào nửa cuối năm nay.

Hãy xem bài phát biểu khai mạc GTC của Huang và khám phá các phiên thảo luận .

Bài viết liên quan

- NVIDIA khơi dậy cuộc cách mạng công nghiệp tiếp theo trong công việc tri thức với nền tảng phát triển tác nhân mở

- Tổng kết NVIDIA GTC 2026 – Tập trung vào Kỷ nguyên của Token và Suy luận

- Tối hậu thư 34 tỷ USD: Vì sao Physical AI sẽ định đoạt ranh giới sinh tử của chuỗi cung ứng trong 24 tháng tới?

- Tương lai của AI: Mở và Độc quyền

- Token đang ăn mòn lợi nhuận của bạn – và bạn thậm chí không thấy nó

- Không chỉ là chatbot: Trí tuệ nhân tạo kiến tạo thế giới thực và 25 startup đột phá tại GTC 2026