Trợ lý nghiệp vụ chuyên sâu: không chỉ là một khung hat

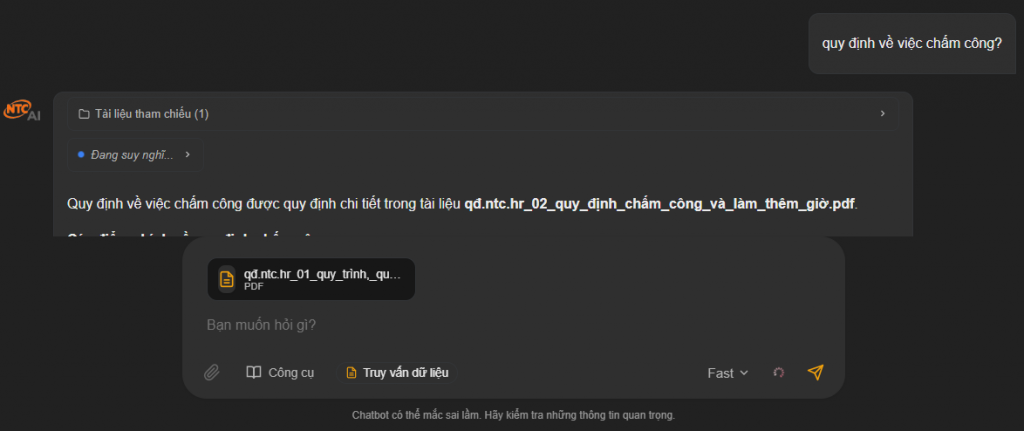

Hệ thống Chatbot của NTC AI được thiết kế xoay quanh hai luồng nghiệp vụ cốt lõi, giải quyết trực tiếp bài toán thực tế của doanh nghiệp.A. Tra Cứu Dữ Liệu RAG "Siêu Tốc" & Linh Hoạt

Không giống các Chatbot thông thường chỉ dựa vào dữ liệu public, Chatbot này truy xuất trực tiếp vào kho tri thức nội bộ của bạn (hỗ trợ đọc sâu các định dạng khó như PDF scan, Word, PPT và hình ảnh). Tìm kiếm toàn cục (Global Search): Khi người dùng đặt câu hỏi (ví dụ: "Hợp đồng thầu phụ dự án X quy định phạt chậm tiến độ thế nào?"), AI sẽ tự động rà quét toàn bộ kho dữ liệu để tổng hợp câu trả lời chính xác nhất. Chỉ định tài liệu mục tiêu (Targeted Search): Chức năng cho phép người dùng đính kèm trực tiếp hoặc tìm kiếm đích danh bằng tay (theo ký tự) các file cụ thể ngay trên UI. Khi đó, AI chỉ tập trung phân tích các file này. Điều này giúp giảm tải cực lớn cho database, tăng tốc độ phản hồi lên tối đa và loại bỏ hoàn toàn rủi ro hallucination (AI bịa thông tin).

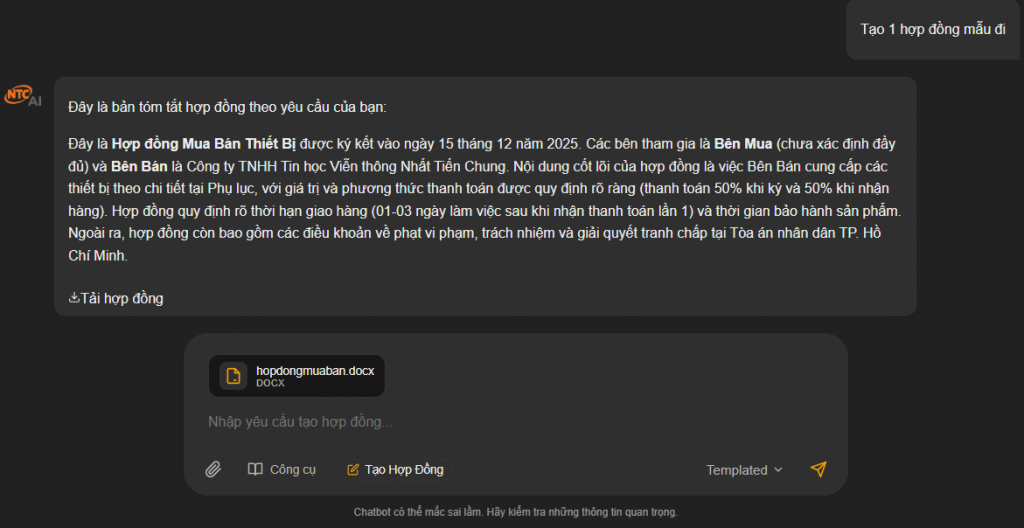

B. Sinh Hợp Đồng Tự Động Từ Template (Auto-Contract Generation)

Hệ thống cho phép người dùng tự do upload các hợp đồng mẫu (template file Word) của riêng doanh nghiệp lên hệ thống. Người dùng chỉ cần chọn template đã upload, sau đó nhập yêu cầu bằng ngôn ngữ tự nhiên (Ví dụ: "Tạo hợp đồng thuê máy xúc với công ty Y, thời hạn 3 tháng, đơn giá 500k/ngày"). Dựa trên bộ system prompt được tinh chỉnh cho từng loại mẫu, LLM sẽ tự động nội suy thông tin, điền vào các trường trống trong template. Kết quả trả ra là một file Word (.docx) hoàn chỉnh, giữ nguyên format gốc của công ty, sẵn sàng để tải xuống, rà soát và ký duyệt.

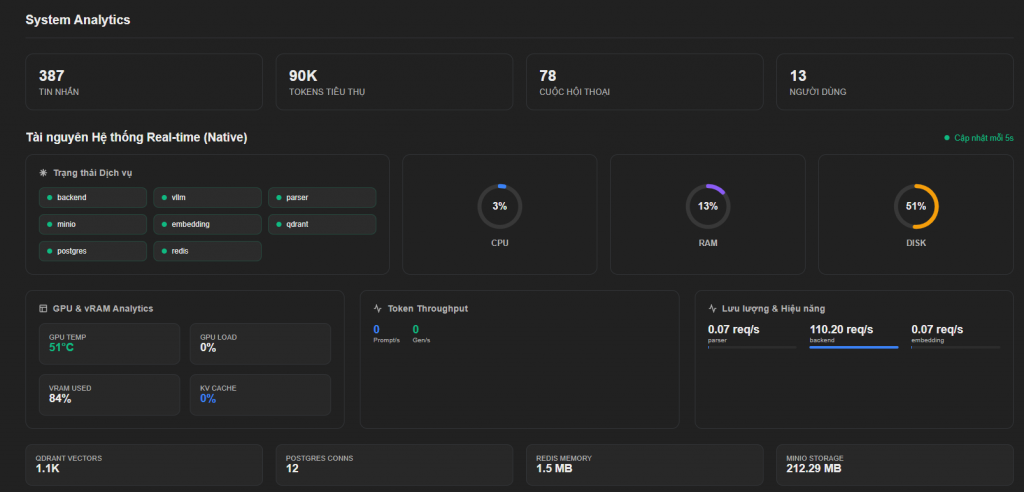

Hệ sinh thái quản trị & bảo mật "chuẩn production"

Sức mạnh của một hệ thống Enterprise nằm ở phần chìm của tảng băng: Hệ thống quản trị (Admin Dashboard) và lớp giáp bảo mật.Hệ thống tính năng quản trị đa dụng

Quản lý Hiệu năng (Performance Dashboard): Cung cấp biểu đồ trực quan về tốc độ phản hồi (latency), số lượng token tiêu thụ, và tải của server. Quản lý Prompt Động: Admin có thể tạo, chỉnh sửa và phân bổ các System Prompt khác nhau cho từng phòng ban hoặc từng nghiệp vụ cụ thể trực tiếp trên giao diện Web mà không cần đụng vào code. Quản lý API & Mail Server: Giao diện cho phép cấu hình linh hoạt thông số kết nối Mail Server (để gửi OTP/Verify) và tích hợp các API LLM bên ngoài làm phương án dự phòng.

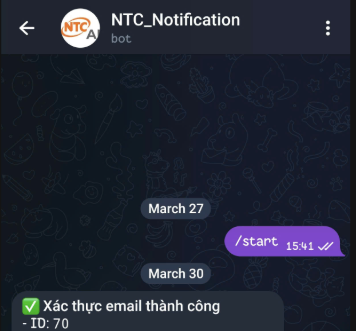

Pháo đài Bảo Mật 2 Lớp (Zero-Trust Approach)

Dữ liệu doanh nghiệp là vô giá vì thế chúng tôi đã thiết lập hàng rào bảo mật nghiêm ngặt: Kiểm soát người dùng: Mọi đăng ký mới đều phải qua bước Verify Email. Tuy nhiên, tài khoản sẽ rơi vào trạng thái Pending. Approval qua Telegram: Hệ thống backend lập tức bắn một thông báo (alert) về nhóm Telegram của Ban Quản Trị. Chỉ khi Admin click "Duyệt", user đó mới có quyền truy cập. Cơ chế này chặn đứng 100% các cuộc tấn công tạo tài khoản spam. Anti-Fraud & Session Control: Tích hợp bộ lọc chặn các IP/VPN độc hại. Đặc biệt, hệ thống sử dụng thuật toán khóa phiên (Session Lock), đảm bảo 1 tài khoản chỉ được phép hoạt động trên 1 thiết bị tại 1 thời điểm, ngăn chặn triệt để hành vi dùng chung tài khoản trái phép.

Kiến trúc tổng thể của dựa án

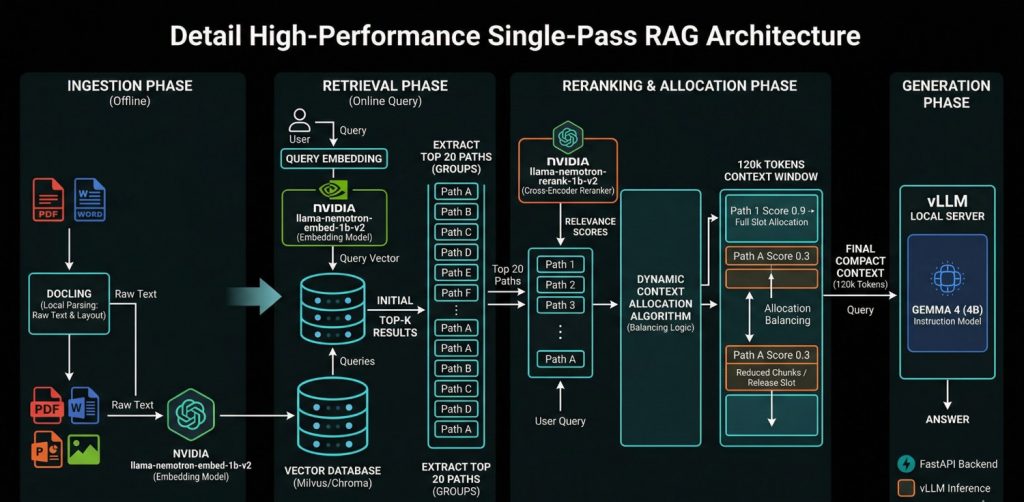

Để đạt được hiệu năng realtime trong môi trường production, đội ngũ NTC AI đã đối mặt và từ chối các kiến trúc RAG hiện đại nhưng cồng kềnh (như Filter-Search Summary, Multi-Agent RAG hay GraphRAG). Các kiến trúc này sử dụng LLM ở nhiều bước trung gian, làm tăng độ trễ (latency) lên ít nhất 4 lần và ngốn tài nguyên cực khủng. Thay vào đó, hệ thống sử dụng kiến trúc Performance-First Single-Pass RAG, chia tách rõ ràng: Next.js xử lý Web/Admin UI, và FastAPI đảm nhiệm toàn bộ Backend Core. Mọi suy luận (inference) được chạy hoàn toàn local qua server vLLM (quản lý containerized qua Docker Compose để đảm bảo tính cô lập và kiểm soát phần cứng GPU khắt khe). Quá trình Ingestion sử dụng Docling local, giải quyết hoàn hảo bài toán bóc tách dữ liệu phức tạp (bảng biểu, PDF, PPT) mà không để lọt dữ liệu ra ngoài internet.Logic Xử Lý Context Động (Dynamic Context Allocation)

Đây là "trái tim" của hệ thống retrieval, được thiết kế để giải quyết bài toán giới hạn token (120k tokens context window) mà vẫn đảm bảo LLM nhận được dữ liệu dày đặc và chất lượng nhất. Luồng xử lý kỹ thuật diễn ra như sau: Dense Retrieval (Search Embedding): Sử dụng modelnvidia/llama-nemotron-embed-1b-v2. Khi có query, hệ thống quét qua Vector DB để lấy ra Top 20 Paths (một path đại diện cho một cụm tài liệu hoặc một chương/mục lớn có ngữ nghĩa liên quan).

Cross-Encoder Reranking: Sử dụng model nvidia/llama-nemotron-rerank-1b-v2. Hệ thống đào sâu vào các chunks bên trong 20 paths này, tính toán lại điểm số tương quan thực tế (relevance score) giữa câu hỏi và từng đoạn text cụ thể.

Thuật Toán Cân Bằng Context (Dynamic Slotting): Thay vì cách làm ngây thơ là nhồi tuột top-K chunks vào prompt cho đến khi đầy, thuật toán của NTC AI phân bổ token dựa trên "trọng số" của từng path.

- Giả sử tổng dung lượng là 120k tokens chia đều cho 20 paths.

- Nếu Path A (score thấp) chỉ có một vài chunk qua được ngưỡng (threshold) của Reranker, nó sẽ giải phóng "slot" (token quota) của mình.

- Hệ thống tự động điều chuyển số token dư thừa này sang cho Path B (score cao, chứa nhiều thông tin dày đặc).

Bạn muốn khám phá khả năng ứng dụng Chatbot AI vào doanh nghiệp của bạn?

Liên hệ tư vấn