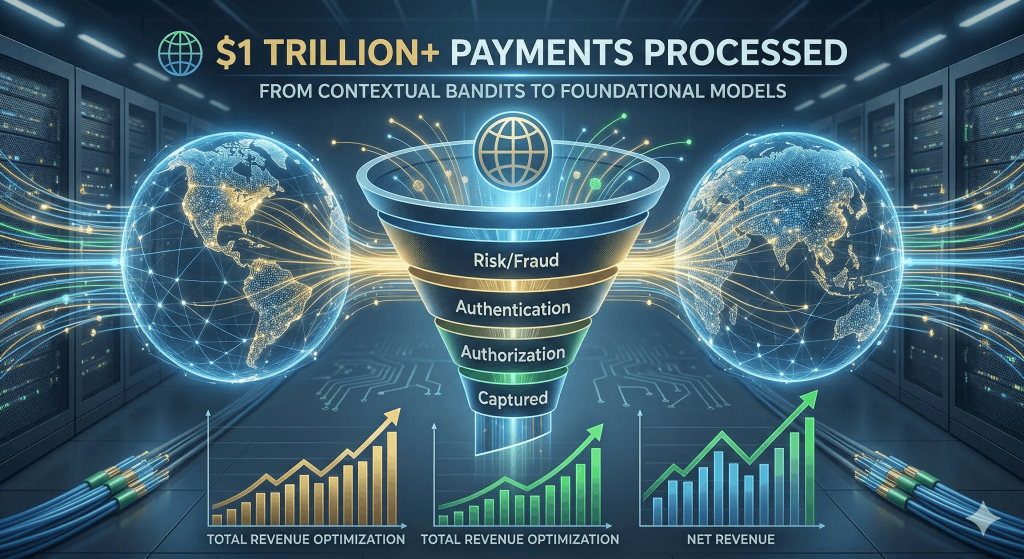

Adyen đang xử lý một khối lượng giao dịch khổng lồ với tổng giá trị hơn 1.09 nghìn tỷ Euro. Đằng sau những API call tưởng chừng đơn giản là một hệ thống tối ưu hóa phức tạp. Khi một nút “Pay now” được click, dòng chảy giao dịch bị rớt qua từng phễu—từ bảo mật, rủi ro gian lận, đến xác thực—và tỷ lệ chuyển đổi cuối cùng có thể chỉ còn 50%.

Bài toán đặt ra cho hệ thống không chỉ là “chấp nhận” hay “từ chối” một giao dịch. Đó là một bài toán tối ưu hóa đa mục tiêu (Multi-objective optimization): tối đa hóa tỷ lệ chuyển đổi (Conversion), tối thiểu hóa chi phí (Cost), và kiểm soát tỷ lệ gian lận (Fraud).

Sự bùng nổ tổ hợp & Contextual Bandits

Trong giai đoạn đầu, việc chọn đường dẫn (routing) và định dạng tin nhắn thanh toán cho các giao dịch phụ thuộc vào hệ thống luật (rule-based) và sau đó là các mô hình Machine Learning truyền thống (Boosting). Tuy nhiên, để thực sự tinh chỉnh từng giao dịch, hệ thống phải quyết định xem nên đi qua kết nối acquirer nào và cấu hình cờ (flags) ra sao.

Khi kết hợp tất cả các routing khả thi cùng hơn 30 cờ tối ưu hóa khác nhau, hệ thống đối mặt với sự bùng nổ tổ hợp với hơn 20,000 action space có thể xảy ra cho mỗi giao dịch. Để giải quyết bài toán này, Adyen đã chuyển sang kiến trúc Deep Learning vào năm 2025, áp dụng cơ chế Self-Attention và mạng DCNv2 (Deep & Cross Network). Kiến trúc này cho phép cross-feature ở bậc cao, tính toán tương tác giữa các dữ liệu phân loại (categorical) và dữ liệu số (numeric) trước khi đưa qua các lớp MLP.

Kỷ nguyên của mô hình nền tảng (Foundational Models)

Kiến trúc phân mảnh—nơi mà đội Fraud, đội Routing, và đội Auth sử dụng các tập dữ liệu độc lập—dẫn đến việc thất thoát tín hiệu (Signal Loss). Tương tự như cách chúng ta gom các luồng dữ liệu thô để tạo thành các pipeline xử lý vector liền mạch, Adyen đã quyết định thống nhất tất cả lượng dữ liệu thô khổng lồ này vào một Mô hình nền tảng (Foundational Model).

Mô hình này hoạt động bằng cách mã hóa các chuỗi giao dịch thành Payment Embeddings. Nó học các biểu diễn ẩn từ chuỗi hành vi của người mua, với quy mô huấn luyện cực kỳ đồ sộ:

- 200 tỷ payments được đưa vào hệ thống.

- Tổng cộng 51.2 nghìn tỷ tokens, vượt xa con số 22 nghìn tỷ tokens văn bản của mô hình Llama 4.

Thay vì chỉ biểu diễn text tĩnh, việc chuyển đổi thông tin dòng tiền thành các vector embedding đa chiều tạo ra một cơ sở dữ liệu mạnh mẽ. Cấu trúc này mở ra khả năng tìm kiếm và nhóm các thực thể giao dịch cực kỳ chuẩn xác—một cơ chế cốt lõi mà bất kỳ ai từng thiết kế các hệ thống Retrieval-Augmented Generation (RAG) hoặc vector database đều sẽ thấu hiểu sự ưu việt của nó.

Cơn ác mộng Hạ tầng & Tối ưu hoá phần cứng NVIDIA

Thách thức lớn nhất khi đẩy một mô hình tỷ trọng lượng vào môi trường production là tốc độ. Hệ thống phải đáp ứng các SLA cực kỳ nghiêm ngặt: độ trễ dưới 30ms (P50 là 20ms) ở những thời điểm peak load lên tới 3000 giao dịch/giây. Đây là một bài toán hóc búa đòi hỏi sự kết hợp tinh tế giữa message broker tốc độ cao và kiến trúc microservices phân tán liền mạch.

Để giải quyết, đội ngũ kỹ sư đã:

- Phân tán các tác vụ xử lý thông qua hệ thống Ray Jobs.

- Triển khai inference trực tiếp trên cụm GPU NVIDIA A100s, đạt được tốc độ tăng gấp 195 lần so với việc chạy inference trên CPU thông thường.

- Tinh chỉnh hệ thống trực tiếp trên bare metal, tích hợp RDMA để loại bỏ độ trễ giao tiếp và theo dõi sát sao chỉ số MFU (Model Flops Utilization).

Đích đến: Học tăng cường (Reinforcement Learning) hợp nhất

Bước tiến cuối cùng của Adyen là quy tụ mọi module về một mục tiêu duy nhất: Tối ưu hóa Net Revenue của toàn phễu giao dịch.

Hệ thống được thiết kế dựa trên triết lý cốt lõi của Học tăng cường (Reinforcement Learning):

- Agent: Sử dụng mạng MLP.

- Environment: Hệ sinh thái thanh toán (Payment ecosystem).

- State: Trạng thái giao dịch được biểu diễn qua Foundational Model.

- Action: Các quyết định routing, áp dụng 3DS, hoặc block giao dịch.

Cơ chế này tương đồng một cách hoàn hảo với cách mà các policy điều khiển được huấn luyện trong những môi trường mô phỏng vật lý khắt khe. Khi hàm phần thưởng (reward) được định nghĩa chuẩn xác—phạt nặng các giao dịch bị block sai hoặc lọt gian lận, thưởng lớn cho các thanh toán mượt mà—hệ thống sẽ tự động học cách luân chuyển từ môi trường huấn luyện ra thực tế production một cách tối ưu nhất.