Kể từ khi ra mắt, NVIDIA đã liên tục nâng cao hiệu năng của DGX Spark sử dụng bộ xử lý Grace Blackwell thông qua việc tối ưu hóa phần mềm liên tục và hợp tác chặt chẽ với các đối tác phần mềm cũng như cộng đồng mã nguồn mở. Những nỗ lực này đang mang lại những cải tiến đáng kể trong các quy trình suy luận, huấn luyện và sáng tạo.

Tại CES 2026, phiên bản phần mềm DGX Spark mới nhất, kết hợp với các bản cập nhật model mới và thư viện mã nguồn mở, mang lại những cải tiến hiệu năng đáng kể cho cả hệ thống DGX Spark và các hệ thống OEM dựa trên GB10.

Mở rộng quy mô các mô hình lớn tại chỗ với bộ nhớ hợp nhất và NVFP4

DGX Spark được thiết kế để làm việc tại chỗ với các mô hình lớn, sở hữu bộ nhớ hợp nhất 128GB trong một form máy tính để bàn cực kỳ nhỏ gọn. Hai hệ thống DGX Spark có thể được kết nối để cung cấp tổng cộng 256GB bộ nhớ, cho phép các nhà phát triển chạy các mô hình thậm chí lớn hơn ngay tại bàn làm việc.

Các hệ thống kết nối với nhau bằng mạng ConnectX-7, cung cấp băng thông 200 Gbps cho các tác vụ đa node tốc độ cao, độ trễ thấp.

Việc hỗ trợ định dạng dữ liệu NVIDIA NVFP4 cho phép các mô hình thế hệ tiếp theo giảm đáng kể dung lượng bộ nhớ sử dụng trong khi tăng thông lượng. Ví dụ, chạy mô hình Qwen-235B sử dụng độ chính xác NVFP4 và giải mã dự đoán mang lại hiệu suất tăng lên tới 2,6 lần so với việc thực thi FP8 trên cùng cấu hình DGX Spark kép.

Với độ chính xác FP8, mô hình làm bão hòa bộ nhớ kết hợp của hai hệ thống, hạn chế khả năng đa nhiệm và độ phản hồi tổng thể. Lượng tử hóa xuống NVFP4 giúp giảm mức sử dụng bộ nhớ khoảng 40% trong khi vẫn duy trì độ chính xác cao, cho phép các nhà phát triển đạt được kết quả tương đương FP8 với hiệu suất cao hơn đáng kể và đủ bộ nhớ trống để chạy nhiều khối lượng công việc khác cùng lúc. Kết quả là trải nghiệm phát triển AI cục bộ trở nên nhanh nhạy và hiệu quả hơn rõ rệt.

Hợp tác mã nguồn mở mở ra những cải tiến hiệu suất tăng thêm

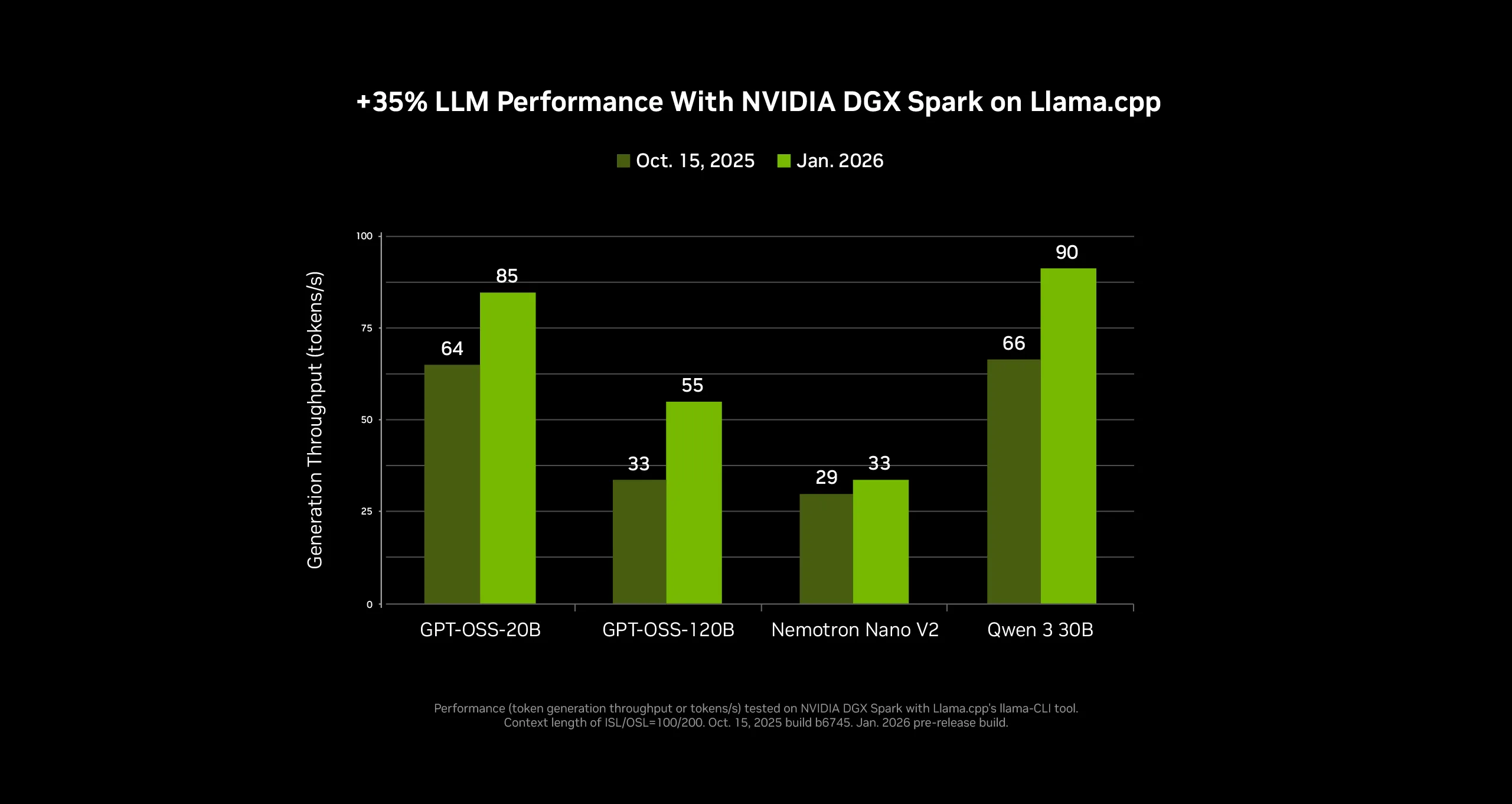

Sự hợp tác của NVIDIA với các đối tác phần mềm mã nguồn mở tiếp tục thúc đẩy hiệu năng lên cao hơn. Các bản cập nhật Llama.cpp mang lại hiệu năng tăng trung bình 35% khi chạy các mô hình mixture-of-experts (MoE) trên DGX Spark – cải thiện cả thông lượng và hiệu quả cho các quy trình công việc mã nguồn mở phổ biến.

Hình 1. Cải thiện hiệu năng của DGX Spark Llama.cpp

Một nền tảng máy tính để bàn mạnh mẽ dành cho nhà sáng tạo

Mặc dù DGX Spark là một nền tảng xuất sắc dành cho các nhà phát triển AI, nhưng các nhà sáng tạo cũng có thể tận dụng các khả năng tương tự như máy tính để bàn của nó.

Bằng cách chuyển giao khối lượng công việc AI cho DGX Spark, nhà sáng tạo có thể giải phóng máy tính xách tay hoặc máy tính để bàn của mình để duy trì khả năng phản hồi trong khi nội dung đang được tạo ra. Với bộ nhớ hợp nhất 128GB, DGX Spark có thể chạy các mô hình lớn như GPT-OSS-120B hoặc FLUX 2 (90GB) ở độ chính xác tối đa, cho phép tạo ra sản phẩm đầu ra chất lượng cao nhất.

Các mô hình khuếch tán (diffusion model) hàng đầu, bao gồm FLUX.2 từ Black Forest Labs và Qwen-Image từ Alibaba, tận dụng NVFP4 để giảm dung lượng bộ nhớ sử dụng trong khi vẫn mang lại hiệu năng cao hơn.

Việc tạo video bằng AI đặc biệt phù hợp với DGX Spark, vì nó đòi hỏi cả bộ nhớ và sức mạnh tính toán đáng kể. Mô hình tạo video-âm thanh LTX-2 mới từ Lightricks, với trọng số được tối ưu hóa cho NVFP8, mang lại hiệu suất vượt trội so với thế hệ trước, giúp việc tạo video chất lượng cao trở nên khả thi trên máy tính để bàn.

DGX Spark hiện đã được đưa vào chương trình Certified-System của NVIDIA.

Chương trình NVIDIA-Certified Systems của NVIDIA xác thực hiệu năng hệ thống trên nhiều loại khối lượng công việc đồ họa, tính toán và trí tuệ nhân tạo được tăng tốc. Hệ thống được chứng nhận của NVIDIA cung cấp nền tảng đáng tin cậy cho việc phát triển trí tuệ nhân tạo, suy luận trên máy tính để bàn, khoa học dữ liệu, thiết kế và tạo nội dung, đồng thời tăng cường tài nguyên trung tâm dữ liệu và đám mây.

Chương trình hiện đã bao gồm các hệ thống DGX Spark và các hệ thống OEM dựa trên chuẩn GB10, với DGX Spark và các hệ thống của đối tác hiện đang trong giai đoạn thử nghiệm.

Các cẩm nang hướng dẫn mới giúp bạn bắt đầu nhanh hơn

Để giúp các nhà phát triển nhanh chóng đạt hiệu quả cao, chúng tôi đang phát hành một bộ playbook DGX Spark mới, giới thiệu những khả năng mà GPU Blackwell mang lại. Các playbook này tập trung vào các quy trình làm việc thực tiễn, dễ áp dụng mà bạn có thể thử ngay lập tức, bao gồm:

- Nemotron 3 Nano: Chạy mô hình MoE 30B tham số hiệu quả của NVIDIA cục bộ để thực hiện thí nghiệm LLM.

- Giao diện WebUI VLM trực tiếp: Truyền phát dữ liệu từ webcam vào các mô hình xử lý ngôn ngữ hình ảnh để phân tích theo thời gian thực, tận dụng sức mạnh xử lý của GPU.

- Isaac Sim / Phòng thí nghiệm: Xây dựng và huấn luyện các ứng dụng robot sử dụng mô phỏng tăng tốc GPU và học tăng cường.

- Các playbook phục vụ SGLang và vLLM: Giờ đây, chúng cần bao gồm một ma trận hỗ trợ mô hình rõ ràng, hiển thị các mô hình đã được kiểm thử và hỗ trợ cùng các tùy chọn lượng tử hóa.

- Các chiến lược xử lý dữ liệu định lượng trong lĩnh vực tài chính và gen học được tăng tốc bằng GPU : Quy trình làm việc với sự thay đổi mã nguồn tối thiểu so với các triển khai trên CPU.

- Tinh chỉnh với PyTorch: Tinh chỉnh phân tán trên hai hệ thống DGX Spark cho các mô hình tuyến tính hỗn hợp (LLM) với tối đa 70 tỷ tham số bằng cách sử dụng FSDP và LoRA.

- Giải mã suy đoán: Một ví dụ mới về EAGLE-3 với GPT-OSS-120B sử dụng đầu soạn thảo tích hợp thay vì mô hình soạn thảo riêng biệt, giúp đơn giản hóa việc triển khai và tăng tỷ lệ chấp nhận mã thông báo.

Mỗi tập lệnh được thiết kế đơn giản và đáng tin cậy, với các bước rõ ràng, hướng dẫn khắc phục sự cố thực tế và cấu hình đã được kiểm chứng trên hệ điều hành DGX mới nhất, giúp bạn dành ít thời gian hơn cho việc thiết lập và nhiều thời gian hơn cho việc xây dựng.

Truy cập DGX Spark của bạn từ bất cứ đâu với NVIDIA Brev

Với NVIDIA Brev, bạn có thể truy cập DGX Spark từ bất cứ đâu thông qua kết nối an toàn. Brev cho phép các nhà phát triển dễ dàng khởi tạo các phiên bản đám mây AI và tận dụng Launchables, chỉ với một cú nhấp chuột để thiết lập môi trường AI. Tại CES, các bản cập nhật cho Brev đã chứng minh khả năng đăng ký điện toán cục bộ, chẳng hạn như DGX Spark. Sau khi đăng ký với Brev, bạn có thể truy cập DGX Spark từ bất cứ đâu. Bạn cũng có thể chia sẻ quyền truy cập một cách an toàn với nhóm của mình.

Brev cho phép triển khai kết hợp giữa các mô hình cục bộ và đám mây. Sử dụng lớp định tuyến, bạn có thể giữ các tác vụ nhạy cảm, chẳng hạn như email hoặc xử lý dữ liệu độc quyền, trên một mô hình mở cục bộ chạy trên DGX Spark, trong khi định tuyến các suy luận tổng quát đến các mô hình tiên tiến trên đám mây. Xem ví dụ dành cho nhà phát triển NVIDIA LLM Router để biết chi tiết triển khai.

Tính năng hỗ trợ tính toán cục bộ của Brev sẽ được giới thiệu trước tại CES, và chính thức ra mắt vào mùa xuân năm 2026.

Biến trợ lý AI của riêng bạn thành hiện thực

Bạn đã sẵn sàng tiến xa hơn chưa? NVIDIA và Hugging Face đã hợp tác để hướng dẫn bạn cách xây dựng một trợ lý AI cá nhân (AI Agent) trên máy tính để bàn. Sử dụng DGX Spark với Reachy Mini, bạn có thể tạo ra một trợ lý AI riêng tư xử lý dữ liệu của bạn một cách kín đáo. Hãy xem hướng dẫn của NVIDIA và Hugging Face để bắt đầu.

Hãy tham gia cộng đồng nhà phát triển DGX Spark và bắt đầu hành trình xây dựng trí tuệ nhân tạo của bạn ngay hôm nay.