Trong y tế, đặc biệt là phẫu thuật nội soi bằng robot, các bác sĩ đang phải đối mặt với một vấn đề lớn: Quá tải nhận thức (Cognitive Overload). Trong một ca phẫu thuật phức tạp — ví dụ như cắt bỏ một phần thận có khối u mà không cần kẹp mạch máu — bác sĩ phải quan sát màn hình nội soi, điều khiển cánh tay robot, và đồng thời xử lý hàng loạt luồng thông tin từ các phần mềm, thiết bị theo dõi khác nhau.

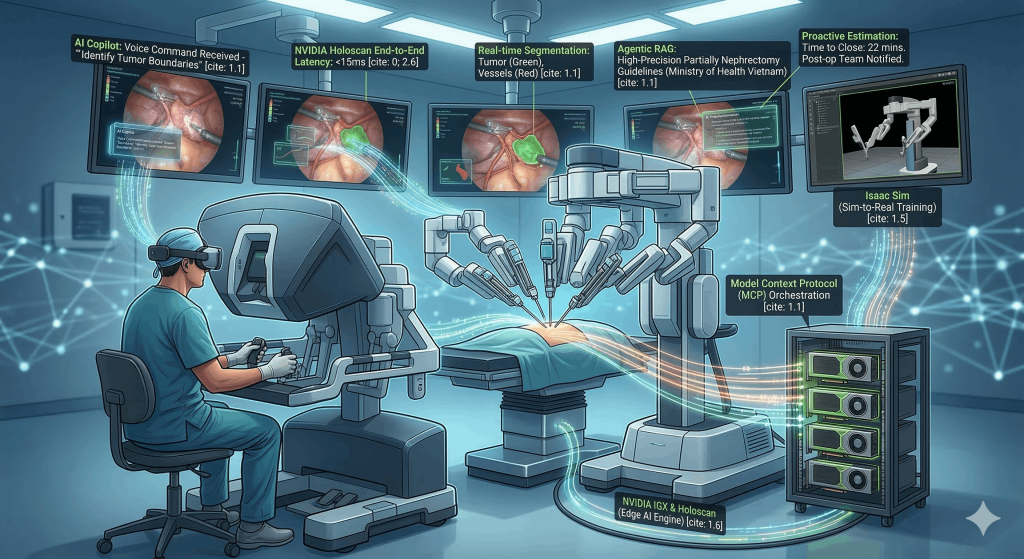

Bài toán đặt ra cho các kỹ sư phần mềm không chỉ là tạo ra các model AI chính xác, mà là làm sao để tích hợp chúng vào một hệ thống theo thời gian thực (real-time) mà không làm phân tâm bác sĩ. Đội ngũ tại Orsi Academy đã giới thiệu một giải pháp kiến trúc đột phá: Surgical AI Copilot – một hệ thống Agentic AI hoạt động như một nhạc trưởng trong phòng mổ.

Giải Mã Kiến Trúc Hệ Thống: Sự Kết Hợp Giữa Edge Compute Và AI Orchestration

Hệ thống được thiết kế dựa trên các nguyên tắc cốt lõi: tương tác bằng giọng nói (Voice-first), độ trễ cực thấp (Ultra-low latency), ẩn mình khi không cần thiết, và chủ động điều phối (Proactive Orchestration).

Tầng Phần Cứng & Xử Lý Tín Hiệu (The Edge Layer)

Phòng mổ là một môi trường “Mission Critical”. Mọi xử lý phải diễn ra tại biên (Edge) thay vì Cloud để đảm bảo tính an toàn và tốc độ.

NVIDIA IGX & Holoscan: Hệ thống chạy trên nền tảng siêu máy tính nội bộ NVIDIA IGX, kết hợp với framework Holoscan. Holoscan đóng vai trò là xương sống xử lý sensor data (như luồng video nội soi) trực tiếp qua GPU. Điều này cho phép hệ thống duy trì độ trễ end-to-end dưới mức 100ms (lý tưởng là dưới 20ms) để không làm ảnh hưởng đến phối hợp tay-mắt của bác sĩ.

Multimodal Inputs: AI không chỉ nhìn luồng video 2D RGB. Nó “nhìn” giống như loài tôm tít (Mantis shrimp) với khả năng xử lý đồng thời ánh sáng phân cực, dữ liệu siêu âm, và mô hình 3D CT scan.

Tầng Điều Phối (The Agentic Copilot Layer)

Thay vì bắt bác sĩ phải dùng tay rời khỏi console robot để thao tác trên màn hình cảm ứng, hệ thống sử dụng Voice AI.

Orchestration qua MCP: Thông qua giao thức Model Context Protocol (MCP), Agentic Copilot có thể “gọi tool” (tool-calling) để thực thi lệnh. Khi bác sĩ nói: “Hãy hiển thị khối u và ẩn các mô xung quanh”, LLM sẽ parse lệnh này, kích hoạt Tool Segmentation trên luồng Holoscan để bóc tách hình ảnh 3D và hiển thị kết quả ngay lập tức lên màn hình.

Chủ động dự đoán (Proactive): Bằng cách phân tích các phase của ca mổ (Ví dụ: Đã đến bước khâu mạch máu), hệ thống tự động tính toán thời gian dự kiến kết thúc ca mổ và gửi thông báo cho đội ngũ hậu cần ở bên ngoài.

Sandbox Dành Cho Dev: Ý Tưởng Triển Khai Mở Rộng

Để xây dựng một kiến trúc Agentic Orchestrator tinh vi như trên, chúng ta cần một tech stack hiện đại từ khâu Inference, xử lý dữ liệu RAG, cho đến Simulation. Dưới đây là các ý tưởng triển khai kỹ thuật sâu hơn:

Tối Ưu LLM Inference Với vLLM Trên Kiến Trúc Grace Blackwell

Việc xử lý Speech-to-Text, suy luận logic (Reasoning), và Text-to-Speech trong phòng mổ đòi hỏi LLM phải có thông lượng (throughput) khổng lồ và Time-to-First-Token (TTFT) cực thấp.

Giải pháp: Triển khai các model ngôn ngữ lớn (như Qwen-32B hoặc Llama-3) bằng vLLM được container hóa qua Docker Compose. Nếu hệ thống backend được trang bị các node GPU thế hệ mới như NVIDIA Grace Blackwell (GB10), vLLM có thể tận dụng tối đa băng thông bộ nhớ, duy trì tốc độ sinh token ở mức lý tưởng để Agent phản hồi lệnh của bác sĩ gần như không có độ trễ.

Kiến Trúc High-Precision RAG Cho Phác Đồ Điều Trị

Trong ca mổ, bác sĩ có thể hỏi Copilot về các chỉ định y khoa (Ví dụ: “Các chỉ định bắt buộc đối với phẫu thuật cắt một phần thận là gì?”). Trả lời sai (Hallucination) là điều tối kỵ.

Giải pháp: Xây dựng một Multi-vector RAG pipeline. Sử dụng các công cụ mạnh mẽ như Marker hoặc Docling để bóc tách chính xác các bảng biểu và text từ các file PDF y văn phức tạp. Sau đó, dữ liệu được chia nhỏ (semantic chunking) và lưu trữ metadata toàn cục/cục bộ vào các Vector Database hiệu năng cao như Qdrant hoặc PostgreSQL (pgvector). Khi LLM truy xuất, nó sử dụng Hybrid Search để kéo ra chính xác guideline của Bộ Y tế hoặc bệnh viện, đảm bảo tính Grounding tuyệt đối.

Sim-to-Real: Đào Tạo Computer Vision Bằng Isaac Sim & ROS2

Việc gán nhãn thủ công cho hàng trăm nghìn frame ảnh nội soi để AI nhận diện dụng cụ phẫu thuật là một cơn ác mộng tốn kém (hơn 2000 giờ làm việc).

Giải pháp: Tạo môi trường phòng mổ ảo bằng NVIDIA Isaac Sim. Thông qua ROS2 Bridge, lập trình viên có thể mô phỏng chính xác động học của cánh tay robot phẫu thuật (như hệ thống Da Vinci). Quan trọng nhất, bằng cách áp dụng Domain Randomization — thay đổi ngẫu nhiên ánh sáng, góc camera, texture của mô phôi và máu lóa trong môi trường ảo — chúng ta có thể sinh ra các tập dữ liệu tổng hợp (Synthetic Data) khổng lồ. Các model Object Detection/Segmentation sẽ được train trên tập dữ liệu này trước khi tinh chỉnh (fine-tune) trên ảnh thật, giúp giảm thiểu đáng kể thời gian đưa model vào thực tế.

Sự chuyển dịch từ “Phần mềm thụ động” sang “Agentic Copilot chủ động” đang định hình lại ngành MedTech. Không chỉ đơn thuần là train một model AI, bài toán của kỹ sư phần mềm giờ đây là kiến trúc hệ thống: Quản lý hàng tá microservices, tối ưu hóa I/O trên GPU để đạt độ trễ mili-giây, và xây dựng các luồng RAG an toàn tuyệt đối. Mọi thứ phải hoạt động hoàn hảo dưới nền background, chỉ xuất hiện khi bác sĩ cần.